Menu

Halüsinasyon Sorununu Çözmek: RAG ve Yerel LLM’lerin Gücü

November 28, 2025 tarihinde yayınlandı

Halüsinasyon Sorununu Çözmek: RAG ve Yerel LLM’lerin Gücü

Yapay zeka sistemleri güçlendikçe, kurumsal tarafta benimsenmesini yavaşlatan önemli bir endişe hâlâ var: halüsinasyonlar. Bu, büyük dil modellerinin çok emin bir dille ama gerçekte yanlış, hatta tamamen uydurma bilgiler üretmesi anlamına geliyor.

Hukuk, finans, sağlık ve kamu gibi alanlarda tek bir hatalı çıktı bile ciddi hukuki, finansal ya da itibar kaybı gibi sonuçlar doğurabilir. Bu dünyada doğruluk “olsa iyi olur” değil—zorunluluktur.

İşte tam bu noktada Retrieval-Augmented Generation (RAG) ve yerel LLM kurulumları oyunun kurallarını değiştiriyor.

Veri Egemenliği: En Önemli Şeyi Kontrol Altında Tutmak

Kurumsal yapay zekanın temel prensiplerinden biri veri egemenliğidir.

Kurumlar şunları net şekilde bilmek zorundadır:

- Verileri nerede saklanıyor

- Kimler erişebiliyor

- Nasıl işleniyor

Yapay zeka sistemlerini kurum içinde (on-premise) ya da özel bulut ortamında çalıştırdığınızda, hassas bilgilerin üçüncü taraf sunuculara gitmesi riski ortadan kalkar. Yerel LLM’ler sayesinde şirket içi dokümanlar, politikalar ve gizli kayıtlar kurumun kontrol ettiği altyapının dışına çıkmaz.

Bu yaklaşım özellikle; sıkı veri koruma kanunlarına ve iç denetim süreçlerine uyması gereken regülasyonlu sektörler için kritik önemdedir.

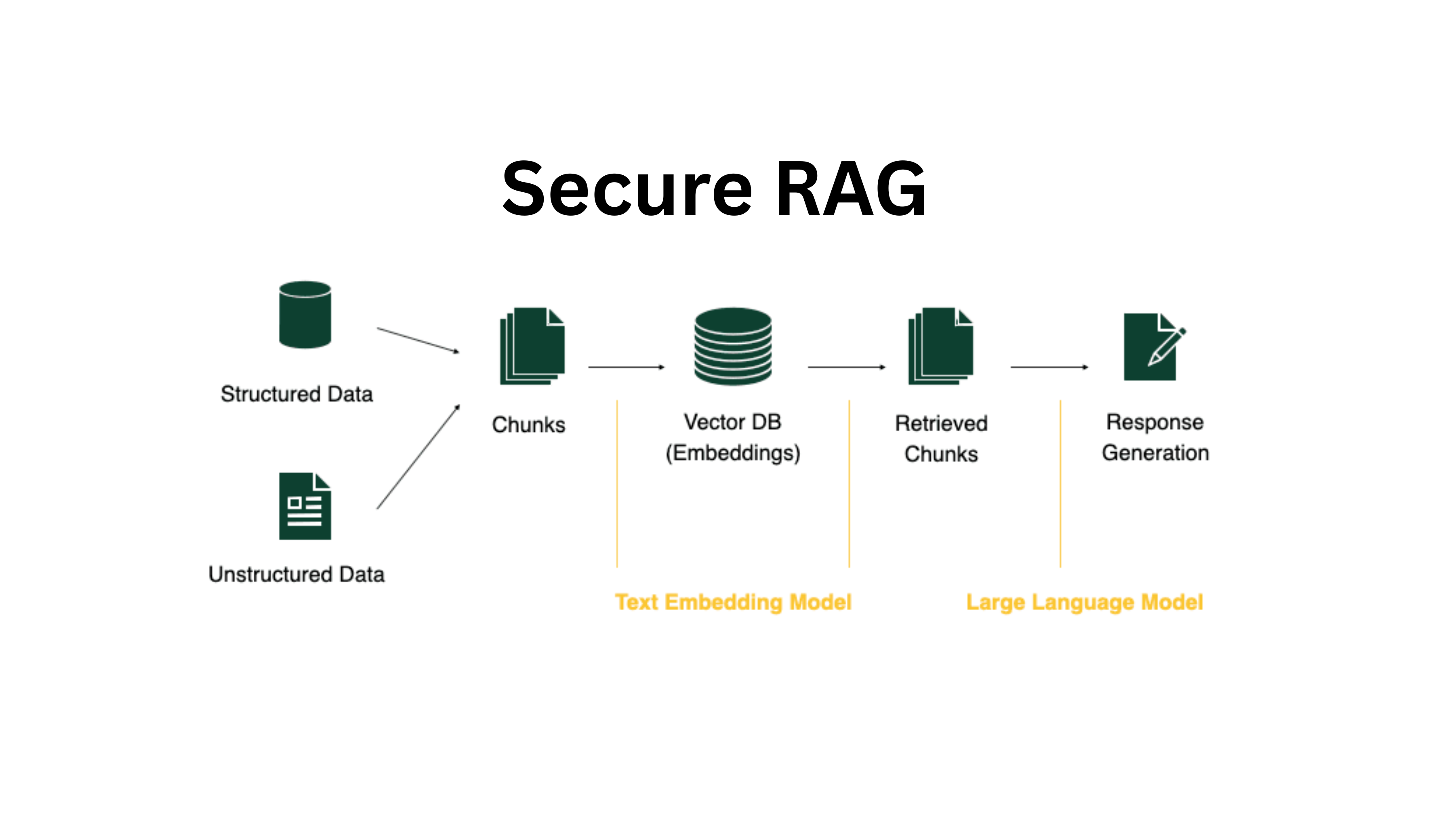

RAG Mimarisi: Yapay Zekayı Gerçek Veriye Oturtmak

Retrieval-Augmented Generation, halüsinasyonun asıl kaynağına doğrudan çözüm getirir.

Modelin sadece kendi “hafızasına” güvenmek yerine, RAG sistemleri:

- Güvenilir kurum içi dokümanlardan ilgili bilgiyi bulur

- Bu bilgiyi doğrudan modelin bağlamına ekler

- Yanıtı yalnızca bu kaynaklara dayanarak üretir

Böylece ortaya çıkan cevaplar gerçek, doğrulanabilir verilere dayanır.

Bilgi tabanında yanıt yoksa sistem uydurmaz; “yok” der.

Bu mimari, LLM’leri yaratıcı metin üreten bir araç olmaktan çıkarıp kurum içinde güvenilir bir bilgi çalışanına dönüştürür.

Çift Katmanlı Doğrulama: Güven, Ama Kontrol Et

AIME’de bu işi bir adım daha ileri taşıyoruz: çift katmanlı doğrulama.

Bu yaklaşımda:

- Birinci model, RAG ile yanıtı üretir

- İkinci model, bu yanıtı bağımsız şekilde kontrol eder

- Tutarsızlıklar, dayanağı olmayan iddialar veya eksik referanslar otomatik olarak işaretlenir

Bu çapraz kontrol mekanizması güvenilirliği ciddi şekilde artırır ve yanlış bilginin kullanıcıya ulaşma ihtimalini minimuma indirir.

Sonuçta ortaya çıkan sistem; klasik bir chatbot gibi değil, disiplinli bir analist gibi çalışır.

Güvenli Yapay Zeka Bir Tercih Değil, Gereklilik

Yapay zeka sistemi tasarımında güvenlik asla sonradan eklenen bir detay olmamalı.

Şunları birlikte kullandığınızda:

- Yerel veri kaynakları

- İzole çalışma ortamları

- RAG ile gerçek veriye dayandırma

- Çoklu model doğrulama

Şirketler hem veri gizliliğini hem de doğruluk seviyesini riske atmadan büyük dil modellerinin gücünden faydalanabilir.

AIME olarak güvenlik, doğruluk ve güveni “ekstra özellik” değil, temelin bir parçası olarak ele alan AI ekosistemleri kuruyoruz. Bu sayede kurumlar, en yüksek güvenlik ve uyumluluk standartlarını koruyarak yapay zekayı büyük ölçekte devreye alabiliyor.